Saya bertanya kepada AI bagaimana kehidupan bermetamorfosa

Inilah hasilnya ketika Saya bertanya kepada AI bagaimana kehidupan bermetamorfosa

Diskursus mengenai senjata otonom yang mematikan masih jauh dari kata usai. Para pengembang teknologi kecerdasan buatan tentunya akan terus berinovasi, sementara pihak yang menentang akan terus menyuarakan kekhawatiran mereka.

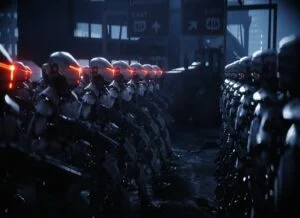

Artikel berjudul Lethal AI weapons are here: how can we control them?” menyelami perdebatan sengit mengenai senjata otonom yang mematikan, yakni senjata yang mampu memilih dan menyerang target tanpa campur tangan manusia. Teknologi ini bagaikan pedang bermata dua, menawarkan potensi manfaat di medan perang namun sekaligus memunculkan dilema etis yang pelik.

Para pendukung senjata otonom optimis teknologi ini dapat meningkatkan presisi serangan dan mengurangi korban sipil dalam peperangan. Kemampuannya untuk memilih target secara mandiri dipandang dapat meminimalisir jatuhnya korban yang tidak bersalah. Para pendukung berargumen bahwa senjata otonom mampu bereaksi lebih cepat dan akurat dibandingkan manusia dalam situasi pertempuran yang dinamis, sehingga dapat mengurangi risiko kesalahan yang disebabkan oleh faktor psikis manusia seperti panik atau kelelahan.

Namun, pandangan ini ditentang oleh kelompok yang menentang senjata otonom. Mereka khawatir bahwa otonomi dalam pemilihan dan penyerangan target justru berpotensi menimbulkan bahaya yang lebih besar. Ketidakpastian dalam pengambilan keputusan oleh mesin dikhawatirkan dapat menyebabkan kesalahan fatal, seperti salah identifikasi target atau kegagalan membedakan antara kombatan dan warga sipil. Lebih lanjut, kemudahan penggunaan senjata otonom dikhawatirkan dapat menurunkan ambang batas negara untuk melancarkan serangan militer, sehingga berpotensi memicu eskalasi konflik bersenjata berskala global.

Selain berpotensi memicu eskalasi konflik, senjata otonom juga memunculkan dilema etis yang rumit. Para peneliti, pakar hukum, dan ahli etika mempertanyakan tanggung jawab atas korban jiwa yang diakibatkan oleh keputusan otonom mesin. Jika terjadi kesalahan atau pelanggaran, siapa yang dapat dimintai pertanggungjawaban: pembuat senjata, pihak yang menggunakannya, atau mesin itu sendiri?

Kekhawatiran mendalam inilah yang mendorong PBB untuk mengambil langkah serius. Artikel tersebut menyebutkan bahwa PBB sedang mempertimbangkan untuk membuat regulasi yang berupa pelarangan pengembangan dan penggunaan senjata otonom. Upaya ini diharapkan dapat menjadi tameng pelindung bagi kemanusiaan di tengah pesatnya perkembangan teknologi persenjataan.

Diskursus mengenai senjata otonom yang mematikan masih jauh dari kata usai. Para pengembang teknologi kecerdasan buatan tentunya akan terus berinovasi, sementara pihak yang menentang akan terus menyuarakan kekhawatiran mereka. Keputusan PBB terkait regulasi senjata otonom nantinya akan menjadi penentu signifikan dalam membentuk masa depan peperangan dan nasib kemanusiaan di era kecerdasan buatan. Akankah senjata otonom menjadi peluru cerdas yang mampu meminimalisir korban sipil, atau justru menjadi kotak pandora yang melepaskan malapetaka bagi umat manusia? Hanya waktu yang dapat menjawabnya.

Inilah hasilnya ketika Saya bertanya kepada AI bagaimana kehidupan bermetamorfosa

Ancaman Baru di Era Kecerdasan Buatan Model Data Poisoning Evasion Hijacking Attack

Data Poisoning Attack Enron: Racun Berbahaya di Balik Skandal Enron Enron, nama yang pernah berkibar di puncak kejayaan, kini terukir dalam sejarah sebagai salah satu skandal perusahaan terbesar di dunia. Di balik gemerlapnya, Enron menyimpan racun mematikan bernama Data Poisoning

atau alat otomasi phishing yang memanfaatkan kecerdasan buatan, semakin marak digunakan untuk melancarkan serangan phishing yang lebih personal dan meyakinkan. Kenali agar kamu tidak menjadi korban.

Teknologi yang dulu hanya ada di ranah fiksi ilmiah kini mewujud nyata, dari asisten virtual yang cerdas hingga mobil self-driving yang menjanjikan kenyamanan. Namun di balik kilaunya yang memesona, AI juga menyimpan bahaya tersembunyi, terutama bila dikaitkan dengan persenjataan. Bagaimana manusia menghadapinya?

Di satu sisi, Kecerdasan Buatan (AI) memberdayakan mesin dengan kemampuan belajar dan berpikir layaknya manusia. Di sisi lain, Blockchain menghadirkan sistem desentralisasi yang aman dan transparan untuk menyimpan dan mentransfer data.